یادگیری عمیق (deep learning)

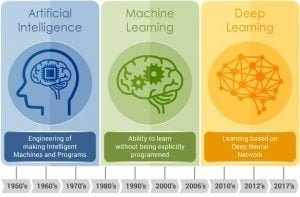

همانطور که در تعدادی از بررسی های اخیر توضیح داده شده است. هوش مصنوعی در چند سال گذشته با پیشرفت های چشمگیر در شبکه های عصبی یا روش های “یادگیری عمیق” متحول شده است.

همانطور که نام “شبکه عصبی” ممکن است نشان دهد. منشأ این روشهای هوش مصنوعی مستقیماً در علوم اعصاب نهفته است. در دهه 1940. تحقیقات در مورد محاسبات عصبی با ساخت شبکه های عصبی مصنوعی که می توانستند توابع منطقی را محاسبه کنند. آغاز شد.

اندکی بعد. دیگران مکانیسم هایی را پیشنهاد کردند که توسط آن شبکه های عصبی ممکن است به صورت تدریجی از طریق بازخورد نظارتی یاد بگیرند. یا به طور مؤثر آمارهای محیطی را به شیوه ای بدون نظارت رمزگذاری می کند.

این مکانیسمها زمینه تحقیقات شبکههای عصبی مصنوعی را باز کردند و همچنان پایه و اساس تحقیقات معاصر در زمینه یادگیری عمیق را فراهم میکنند.

پردازش توزیع شده

مدت زیادی پس از این کار پیشگامانه. توسعه الگوریتم پس انتشار اجازه داد تا یادگیری در شبکه های متشکل از چندین لایه رخ دهد.

قابل ذکر است. پیامدهای این روش برای درک هوش. از جمله هوش مصنوعی. برای اولین بار توسط گروهی از دانشمندان علوم اعصاب و دانشمندان علوم شناختی که تحت عنوان پردازش موازی توزیع شده (PDP) کار می کنند. مورد توجه قرار گرفت. (Rumelhart et al., 1986).

در آن زمان. بیشتر تحقیقات هوش مصنوعی بر ساخت سیستمهای پردازش منطقی مبتنی بر محاسبات سریال متمرکز بود. رویکردی که تا حدی از این ایده الهام گرفته شده بود که هوش انسانی شامل دستکاری نمایشهای نمادین است (هاگلند. 1985).

با این حال. در برخی زمینهها این احساس رو به رشد وجود داشت که رویکردهای صرفا نمادین ممکن است برای حل مشکلات پیچیده دنیای واقعی از آن دسته که انسانها به طور معمول به آن رسیدگی میکنند. بسیار شکننده و غیرقابل انعطاف باشند. درعوض. به نظر می رسید که پایه دانش در مورد مغز در جهت بسیار متفاوتی قرار دارد و نقش پردازش اطلاعات تصادفی و بسیار موازی شده را برجسته می کند.

با تکیه بر این. جنبش PDP پیشنهاد کرد که شناخت و رفتار انسان از تعاملات پویا و توزیع شده در شبکههای واحدهای پردازش نورونمانند ساده پدید میآید. تعاملهایی که با روشهای یادگیری تنظیم میشوند که پارامترهای سیستم را به منظور به حداقل رساندن خطا یا به حداکثر رساندن پاداش تنظیم میکنند.

تاثیر بر هوش مصنوعی

اگرچه رویکرد PDP در ابتدا برای مسائل نسبتاً کوچک به کار گرفته شد. اما موفقیت چشمگیری در حسابداری طیف وسیعی از رفتارهای انسانی نشان داد (هینتون و همکاران. 1986). در طول مسیر. تحقیقات PDP مجموعه متنوعی از ایدهها را معرفی کرد که تأثیر مستمری بر تحقیقات هوش مصنوعی داشتهاند.

به عنوان مثال. تحقیقات ترجمه ماشینی کنونی از این مفهوم استفاده می کند که کلمات و جملات را می توان به شکلی توزیع شده (یعنی به عنوان بردار) نشان داد (LeCun et al., 2015

اصلی که قبلاً در مدلهای اولیه پردازش جملات الهام گرفته از PDP ریشه دوانده بود (St. John and McClelland, 1990).

با تکیه بر جذابیت جنبش PDP به محاسبات بیولوژیکی. شبکههای عصبی کانولوشنال (CNN) با آخرین ویژگیهای متعارف محاسبات عصبی. از جمله مبدل غیرخطی. عادیسازی تقسیمبندی. و ادغام ورودیهای مبتنی بر حداکثر (Yamins و DiCarlo) را در خود جای داده است.

این عملیات مستقیماً از ضبطهای تک سلولی از قشر بینایی پستانداران الهام گرفته شده است که نشان میدهد چگونه ورودی بصری فیلتر شده و در سلولهای ساده و پیچیده در ناحیه V1 جمع میشود (Hubel and Wiesel, 1959).

. علاوه بر این. معماریهای شبکه کنونی سازماندهی سلسله مراتبی سیستمهای قشری پستانداران را با جریان اطلاعات همگرا و واگرا در لایههای پردازشی تودرتو تکرار میکنند (کریژفسکی و همکاران. 2012). پس از ایده هایی که برای اولین بار در مدل های اولیه شبکه عصبی پردازش بصری توسعه یافت (فوکوشیما. 1980)

اطلاعات در سیستم های بیولوژیکی

در هر دو سیستم بیولوژیکی و مصنوعی. محاسبات غیر خطی پی در پی. ورودی بصری خام را به مجموعهای از ویژگیهای پیچیده تبدیل میکند و امکان تشخیص شی را فراهم میآورد که نسبت به تبدیل حالت. روشنایی یا مقیاس ثابت است.

همانطور که زمینه یادگیری عمیق از تحقیقات PDP به یک حوزه اصلی در هوش مصنوعی تبدیل شد. با ایده های جدیدی مانند توسعه شبکه های باور عمیق تقویت شد (هینتون و همکاران. 2006).

و معرفی مجموعه داده های بزرگ با الهام از تحقیقات روی زبان انسان (دنگ و همکاران. 2009)

. در این دوره. همچنان به استخراج ایده های کلیدی از علوم اعصاب ادامه داد. برای مثال. ملاحظات بیولوژیکی از توسعه طرحهای منظمسازی موفقی خبر داد که از تعمیم فراتر از دادههای آموزشی پشتیبانی میکنند.

یکی از این طرحها. که در آن تنها زیرمجموعهای از واحدها در پردازش یک مثال آموزشی معین شرکت میکنند. انگیزه تصادفی است که در سیستمهای بیولوژیکی پر شده توسط نورونهایی که با آمارهای پواسون مانند شلیک میکنند (هینتون و همکارانش) است. در اینجا و جاهای دیگر. علوم اعصاب راهنمایی اولیه را به سمت محدودیتهای معماری و الگوریتمی ارائه کرده است که منجر به برنامههای کاربردی شبکه عصبی موفق برای هوش مصنوعی میشود.

یادگیری تقویتی

در کنار نقش مهم خود در توسعه یادگیری عمیق. علوم اعصاب همچنین در ایجاد ستون دوم هوش مصنوعی معاصر. تحریک کننده ظهور حوزه یادگیری تقویتی (RL) بود. روشهای RL مشکل چگونگی به حداکثر رساندن پاداش آینده را با نگاشت وضعیتهای محیط به اقدامات نشان میدهند و از جمله ابزارهای پرکاربرد در تحقیقات هوش مصنوعی هستند (Sutton and Barto, 1998).

اگرچه در بین محققان هوش مصنوعی به طور گسترده ای مورد استقبال قرار نمی گیرد. روش های RL در اصل از تحقیقات در مورد یادگیری حیوانات الهام گرفته شده است. به طور خاص. توسعه روشهای تفاوت زمانی (TD). یک جزء حیاتی بسیاری از مدلهای RL. به طور جدایی ناپذیری با تحقیق در مورد رفتار حیوانات در آزمایشهای شرطیسازی در هم تنیده شد.

روشهای TD مدلهای بلادرنگی هستند که از تفاوتهای بین پیشبینیهای موقتی متوالی درس میگیرند. نه اینکه منتظر بمانند تا پاداش واقعی تحویل داده شود. اثری به نام شرطی سازی مرتبه دوم از اهمیت ویژه ای برخوردار بود. که در آن اهمیت عاطفی به یک محرک شرطی (CS) از طریق ارتباط با CS دیگر به جای مستقیم از طریق ارتباط با محرک غیرشرطی اعطا می شود (Sutton and Barto, 1981).

یادگیری TD توضیحی طبیعی برای شرطی سازی مرتبه دوم ارائه می دهد و در واقع طیف وسیع تری از یافته های علوم اعصاب را توضیح می دهد. همانطور که در زیر بحث می کنیم.

در اینجا. مانند مورد یادگیری عمیق. تحقیقات در ابتدا با الهام از مشاهدات علوم اعصاب منجر به پیشرفتهای بیشتری شد که به شدت جهت تحقیقات هوش مصنوعی را شکل داده است. روشهای TD و تکنیکهای مرتبط از منشاء علم اعصاب خود. برای تامین فناوری اصلی پیشرفتهای اخیر در هوش مصنوعی. از کنترل رباتیک (هافنر و ریدمیلر. 2011) ادامه یافتهاند.